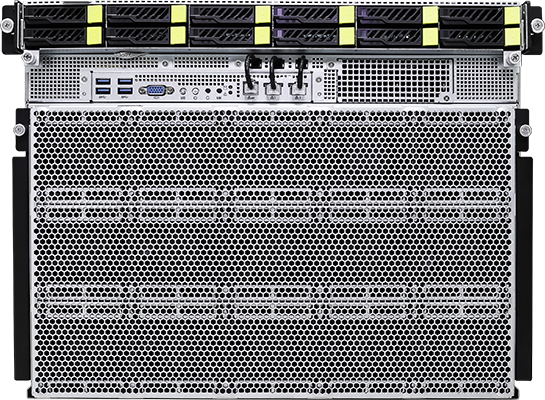

TITAN GM645R-G6

Serveur IA et GPU

- 4U NVIDIA MGX™

- Double processeur AMD EPYC™ série 9005

- Prend en charge 8 GPU de 600 W TDP chacun

- Jusqu’à 4 To de mémoire DDR5 6400 MT/s

- 8 baies de disques NVMe E1.S et 2 x M.2

- Gestion ASPEED AST2600

- Alimentation 3200 W (3+1) 80 PLUS Titanium

- Idéal pour l’IA générative, l’IA agentique, l’IA industrielle et physique, l’analyse de données, la simulation et le rendu accéléré par IA

Aperçu du produit

Le CIARA TITAN GM645R-G6 est un serveur NVIDIA MGX™ 4U conçu pour l’IA générative, l’IA agentique, l’IA industrielle et physique, l’analyse de données, la simulation et le rendu accéléré par IA. Équipé de deux processeurs AMD EPYC™ série 9005 (jusqu’à 400 W de TDP chacun), il offre de solides performances de calcul multicœur pour les charges de travail intensives en données et accélérées par GPU.

Conçu sur l’architecture modulaire NVIDIA MGX™, le système prend en charge jusqu’à huit GPU NVIDIA, notamment le NVIDIA RTX PRO™ 6000 Blackwell Server Edition, les H200 NVL, H100 NVL et L40S, en offrant un flux d’air optimisé, un espacement des emplacements et une alimentation adaptés pour maintenir des performances GPU soutenues en charge continue.

Avec la prise en charge jusqu’à 4 To de mémoire DDR5 6400 MT/s (RDIMM/3DS RDIMM), huit baies NVMe E1.S, deux périphériques de stockage M.2, et jusqu’à huit ports QSFP112 400 Gb/s via NVIDIA ConnectX®-8, le CIARA TITAN GM645R-G6 fournit le débit réseau, la bande passante mémoire, la densité de stockage et l’évolutivité nécessaires aux clusters IA modernes et aux déploiements GPU haute puissance de nouvelle génération.

Caractéristiques et avantages clés

Calcul AMD EPYC™ pour des charges de travail IA avancées

Le CIARA TITAN GM645R-G6 intègre deux processeurs AMD EPYC™ série 9005 (jusqu’à 400 W de TDP chacun), offrant de puissantes performances de calcul multicœur pour l’IA générative, l’IA agentique, l’IA industrielle et physique, l’analytique de données, la simulation scientifique et le rendu accéléré par IA. Cette architecture traite efficacement les données et maintient une forte utilisation GPU lors d’opérations intensives multi-nœuds.

Architecture MGX™ pour des performances optimisées par GPU

Basé sur la plateforme modulaire NVIDIA MGX™, le système prend en charge jusqu’à huit GPU NVIDIA (600 W de TDP chacun), dont le NVIDIA RTX PRO™ 6000 Blackwell Server Edition, les H200 NVL, H100 NVL et L40s, avec un flux d’air, une alimentation et un espacement des emplacements standardisés. Cela garantit un refroidissement constant, des performances multi‑GPU stables et la flexibilité d’adopter les GPU de nouvelle génération.

Réseau haut débit pour les clusters IA

Le système inclut huit ports QSFP112 400 Gb/s pilotés par NVIDIA ConnectX®-8, offrant une bande passante réseau ultra‑élevée pour l’entraînement distribué, l’inférence multi‑nœuds et l’accélération des transferts de données dans des environnements IA. Cette connectivité haute vitesse assure l’évolutivité nécessaire aux environnements IA et HPC modernes.

Mémoire à large bande passante et architecture de stockage E1.S

Avec la prise en charge jusqu’à 4 To de mémoire DDR5 6400 MT/s (RDIMM/3DS RDIMM), huit baies NVMe E1.S, deux périphériques de stockage M.2, et jusqu’à huit ports QSFP112 400 Gb/s via NVIDIA ConnectX®-8, le CIARA TITAN GM645R-G6 fournit le débit réseau, la bande passante mémoire, la densité de stockage et l’évolutivité requises pour les clusters IA modernes et les déploiements GPU haute puissance de nouvelle génération.

Idéal pour

IA générative

IA agentique

Rendu accéléré par IA

IA industrielle

IA physique

Analyse de données

Simulation

Spécifications techniques

Ressources

Produits connexes

On est là pour vous

Deploy AI & GPU Servers